谷歌的AutoFlip使用人工智能为你裁剪视频

为电视拍摄和编辑的视频通常是在横向创建和观看,但问题是,像16:9和4:3这样的高宽比并不总是适合用于观看的显示器。幸运的是,谷歌正在处理这个问题。今天它详细介绍了AutoFlip,一个用于智能视频重构的开源工具。在给定视频和目标维数的情况下,分析视频内容,制定最优的跟踪和裁剪策略,然后在期望的长宽比下生成持续时间相同的输出视频。

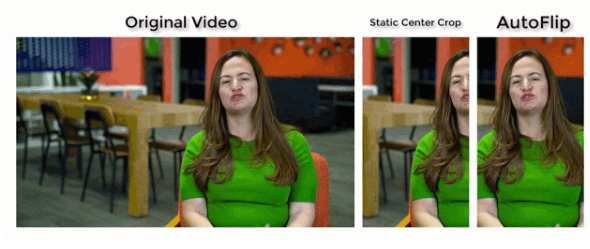

谷歌Research的高级软件工程师Nathan Frey和高级软件工程师Zheng Sun在一篇博客文章中指出,传统的视频重构方法通常涉及静态裁剪,这往往会导致不满意的结果。更多的定制方法是更好的,但它们通常需要视频管理员手动识别每一帧的突出内容,跟踪它们在帧与帧之间的转换,并在整个视频中相应地调整作物区域。

相比之下,AutoFlip是完全自动的,这要归功于人工智能对象检测和跟踪技术,这些技术能够智能地理解视频内容。系统检测组成中表示场景变化的变化,以便隔离场景进行处理。在每个镜头中,它使用视频分析来识别突出的内容,然后重新构建场景,主要是通过选择一个优化的相机模式和路径。

为了检测视频中的镜头何时变化,AutoFlip计算每一帧的颜色直方图,并将其与之前的帧进行比较。如果帧颜色的分布变化的速度不同于滑动的历史窗口,则会发出镜头变化的信号。AutoFlip会缓冲视频,直到场景完成,然后再做出重新构图的决定,从而优化整个场景的重新构图。

AutoFlip还利用基于AI的对象检测模型来发现框架中有趣的内容,比如人、动物、文本覆盖、标识和运动。人脸和目标检测模型与AutoFlip through MediaPipe集成在一起,该框架支持开发处理多模态数据的管道,它在处理器上使用了谷歌的TensorFlow Lite机器学习框架。根据谷歌,这个结构允许AutoFlip可扩展,因此开发人员可以为不同的用例和视频内容添加检测算法。

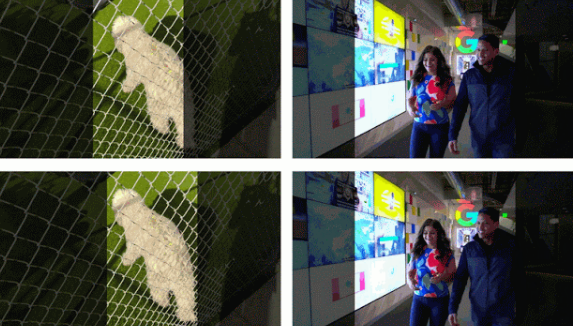

AutoFlip会根据物体在场景中的行为方式,自动选择重建策略——静止、平移或跟踪。在固定模式下,重新定义的摄像机视口被固定在一个位置上(像一个固定的三脚架),在这里重要的内容可以在大部分场景中被看到。另一方面,平移模式以恒定的速度移动视口,而跟踪模式在物体在框架内移动时提供连续稳定的跟踪。

根据选择的重新构建策略,AutoFlip确定每个框架的裁剪窗口,同时保留感兴趣的内容。配置图提供了重新构建的设置,这样,如果无法覆盖所有需要的区域,系统将自动切换到一个不太积极的策略,通过应用信箱效应,填充图像来填充框架。AutoFlip将绘制背景颜色(如果是纯色),以确保填充混合,或者使用原始框架的模糊版本。

研究者留给未来的工作改善AutoFlip探测的能力”对象相关视频的目的”,如扬声器检测接受采访或动画卡通人脸检测,并确保输入视频覆盖在屏幕的边缘(如文字或标识)不出现的观点。但他们断言,即使以目前的形式,AutoFlip也会“减少……设计创意的障碍”。

“通过结合文本/标志检测和图像绘制技术,我们希望未来版本的AutoFlip可以重新定位前景对象,以更好地适应新的长宽比。在需要填充物的情况下,深层uncrop技术可以提供改进的能力,扩展到原始可视区域之外,”Frey和Sun写道。“我们很高兴能将这个工具直接发布给开发者和电影制作人,减少他们设计创意的障碍,并通过视频编辑的自动化来实现。”随着视频内容消费设备的多样性继续迅速增加,使任何视频格式适应各种长宽比的能力变得越来越重要。”

声明:本文由易百纳技术社区编写,文章内容来自venturebeat,版权归原作者所有,转载请注明出处,如有侵权请联系删除。

- 分享

- 举报

暂无数据

暂无数据-

浏览量:1952次2023-03-15 14:57:11

-

浏览量:1134次2023-08-04 10:24:56

-

浏览量:1876次2023-09-22 11:21:03

-

浏览量:3240次2020-03-04 09:17:27

-

浏览量:1296次2023-10-24 13:59:57

-

浏览量:2652次2017-12-01 17:23:13

-

浏览量:2817次2018-01-02 15:43:33

-

浏览量:2480次2018-12-25 18:54:12

-

浏览量:1874次2020-01-02 10:17:37

-

浏览量:2164次2018-05-13 17:31:06

-

浏览量:2810次2019-05-07 11:29:06

-

浏览量:3317次2020-11-23 11:07:15

-

浏览量:2642次2017-12-25 00:02:34

-

2023-07-27 10:37:21

-

浏览量:947次2023-09-16 10:51:37

-

浏览量:2172次2019-12-10 11:40:27

-

浏览量:1666次2018-02-04 16:47:18

-

浏览量:1543次2023-07-04 14:11:52

-

浏览量:3367次2019-12-23 10:36:02

-

广告/SPAM

-

恶意灌水

-

违规内容

-

文不对题

-

重复发帖

tomato

微信支付

微信支付举报类型

- 内容涉黄/赌/毒

- 内容侵权/抄袭

- 政治相关

- 涉嫌广告

- 侮辱谩骂

- 其他

详细说明

微信扫码分享

微信扫码分享 QQ好友

QQ好友