资讯文章

针对不断增长的AI市场,Nvidia发布新的双 GPU 产品

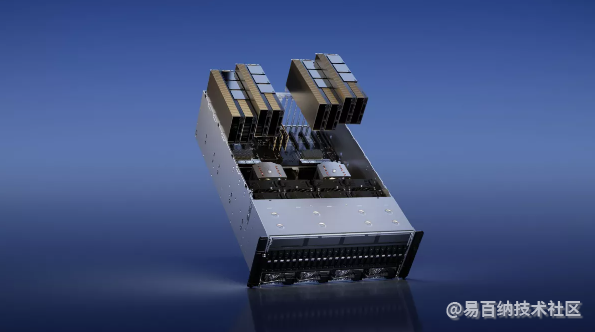

英伟达在其 GTC 100 年春季主题演讲中宣布了一款新的双 GPU 产品 H2023 NVL,针对不断增长的AI市场。根据Nvidia发布的信息和图像,H100 NVL(H100 NVLink)将在顶部安装三个NVLink连接器,两个相邻的卡插入单独的PCIe插槽。

这显然是为了适应不支持英伟达ssm选项的服务器,重点是推理性能而不是训练。NVLink连接应该有助于提供NVSwitch在ssm解决方案上所缺少的带宽,而且还有其他一些显著的区别。

以前的H100解决方案(SXM和PCIe)都配有80GB的HBM3内存,但实际的封装包含六个堆栈,每个堆栈都有16GB的内存。目前尚不清楚是一个堆栈被完全禁用,还是用于ECC或其他目的。我们所知道的是,H100 NVL每个GPU将配备94GB,HBM3总计将配备188GB。我们假设每个GPU“缺失”的2GB现在用于ECC。

功率略高于H100 PCIe,每个GPU的功率为350–400W(可配置),增加了50W。同时,总性能实际上是H100 SXM的两倍:FP64的134万亿次,TF32的1979万亿次,以及FP8的7916万亿次(以及INT8的791万亿次)。

基本上,这看起来与H100 PCIe的核心设计相同,它也支持NVLink,但现在可能启用了更多的GPU核心,内存增加了17.5%。内存带宽也比H100 PCIe高出一点,每个GPU为3.9 TB/s,总带宽为7.8 TB/s(而H100 PCIe为2 TB/s,H100 SXM为3.35 TB/s)。

声明:本文内容由易百纳平台入驻作者撰写,文章观点仅代表作者本人,不代表易百纳立场。如有内容侵权或者其他问题,请联系本站进行删除。

红包

点赞

收藏

评论

打赏

- 分享

- 举报

评论

0个

手气红包

暂无数据

暂无数据相关专栏

-

浏览量:4782次2021-05-27 18:31:41

-

浏览量:2743次2020-07-30 18:04:03

-

浏览量:3307次2022-01-04 09:00:34

-

浏览量:2563次2019-11-07 14:15:02

-

浏览量:4879次2021-08-20 09:24:15

-

浏览量:2280次2018-04-01 21:55:54

-

浏览量:3701次2020-07-22 14:52:19

-

浏览量:4843次2021-09-24 09:30:49

-

浏览量:2524次2020-04-21 10:55:53

-

浏览量:2816次2019-11-22 14:11:11

-

浏览量:3678次2020-12-10 10:53:29

-

2021-08-28 16:04:47

-

浏览量:3553次2022-03-27 09:00:20

-

浏览量:3367次2024-02-27 11:49:53

-

浏览量:3963次2022-03-20 09:01:41

-

浏览量:4880次2021-04-02 09:47:41

-

浏览量:2776次2020-07-30 18:22:15

-

浏览量:4804次2022-01-04 09:00:18

-

浏览量:3067次2020-11-18 10:04:10

置顶时间设置

结束时间

删除原因

-

广告/SPAM

-

恶意灌水

-

违规内容

-

文不对题

-

重复发帖

打赏作者

Ocean

您的支持将鼓励我继续创作!

打赏金额:

¥1

¥5

¥10

¥50

¥100

支付方式:

微信支付

微信支付

举报反馈

举报类型

- 内容涉黄/赌/毒

- 内容侵权/抄袭

- 政治相关

- 涉嫌广告

- 侮辱谩骂

- 其他

详细说明

审核成功

发布时间设置

发布时间:

请选择发布时间设置

是否关联周任务-专栏模块

审核失败

失败原因

请选择失败原因

备注

请输入备注

微信扫码分享

微信扫码分享 QQ好友

QQ好友