如何用AI实现视频防抖?还是无需裁剪画面的那种

右边的画面,是不是比左边的画面看上去稳定许多?

这样的效果,大家可能并不陌生。现在,不少手机厂商都为自家手机配备了类似的防抖算法,为你拍摄生活Vlog提供便利。

不过,目前的智能手机在面对复杂的抖动时,主要是通过电子防抖(EIS)的方式来实现画面的稳定。

也就是说,需要对画面的边界进行裁剪,通过“后期处理”,实现画面的稳定:

而现在,一项来自台湾大学、谷歌、弗吉尼亚理工大学和加州大学默塞德分校等研究机构的论文,提出了一种无需裁剪的全帧视频稳定算法。

即使是奔跑中拍摄的画面,也能稳定不少。

那么,这只AI具体是如何做到防抖的?

方法原理

该方法的核心思想,是融合视频中多个相邻帧的信息,来呈现无需裁剪的完整稳定视频。

具体而言,对于输入视频,首先对每一帧图像特征进行编码,并在目标时间戳处将相邻帧翘曲至虚拟相机空间。

这里面主要用到了目标帧到关键帧的翘曲场,以及从关键帧到相邻帧的估计光流两个信息,这样,就可以通过链接流向量,计算目标帧到相邻帧的翘曲场。

然后,融合这些特征。

实验结果

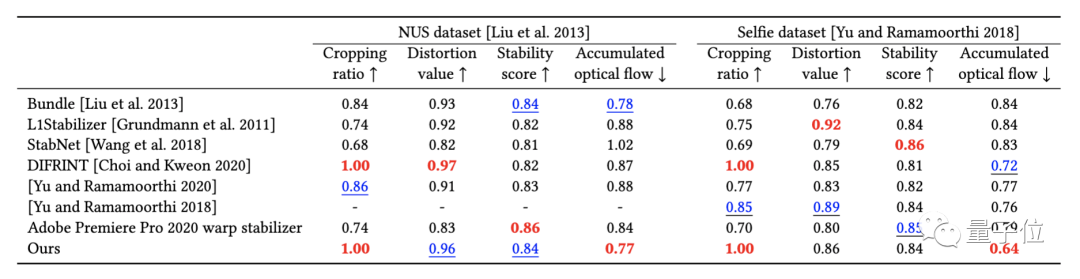

研究人员在NUS数据集和自拍视频数据集上验证了该方法。

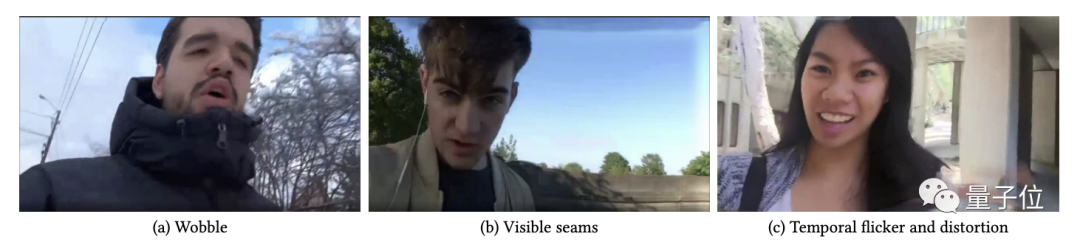

在上表中,DIFRINT方法同样是无需裁剪的方法。虽然该方法在失真值(distortion value)上略优于本文方法,但如下图所示,DIFRINT的结果中有明显的局部失真。

总体而言,本文提出的方法优于此前的SOTA方法。

不过,论文也谈到了该方法的局限性,比如对卷帘式快门无效;如果视频帧间亮度变化很大,会导致明显的接缝;预处理阶段的平滑方法可能会导致失真等。

传送门

根据作者介绍,该项目即将开源,如果感兴趣,不妨先mark一下~

论文地址:

https://arxiv.org/abs/2102.06205

项目地址:

https://alex04072000.github.io/NeRViS/

来源:opencv学堂

- 分享

- 举报

暂无数据

暂无数据-

浏览量:10711次2021-02-23 14:31:42

-

浏览量:6184次2021-04-23 14:10:42

-

浏览量:2697次2020-06-28 13:50:03

-

浏览量:3095次2022-10-09 10:38:23

-

浏览量:5011次2022-02-22 09:01:56

-

浏览量:6669次2021-04-01 16:47:04

-

浏览量:2538次2019-11-08 16:24:58

-

浏览量:6425次2021-04-01 16:24:41

-

浏览量:2883次2022-03-11 09:01:37

-

浏览量:5436次2021-08-31 14:02:41

-

浏览量:2271次2022-01-17 09:01:34

-

浏览量:1596次2023-01-12 12:51:39

-

浏览量:3763次2022-10-19 09:59:40

-

浏览量:3060次2022-03-26 09:00:29

-

浏览量:2497次2019-06-28 14:25:24

-

浏览量:3270次2020-02-14 11:29:22

-

浏览量:4762次2020-07-27 15:12:15

-

浏览量:4832次2021-04-01 13:54:47

-

浏览量:5755次2021-04-23 14:11:19

-

广告/SPAM

-

恶意灌水

-

违规内容

-

文不对题

-

重复发帖

AI算法识别

微信支付

微信支付举报类型

- 内容涉黄/赌/毒

- 内容侵权/抄袭

- 政治相关

- 涉嫌广告

- 侮辱谩骂

- 其他

详细说明

微信扫码分享

微信扫码分享 QQ好友

QQ好友